标签: #AI

最近,一个国产开源项目凭借高质量的代码、飞快的迭代速度和简洁友好的操作体验正在悄然崛起。短短半年内,这个项目已经在国内外开源社区获得了众多的拥趸和生产用户。它就是今天要介绍的开源项目 - GPUStack。

GPUStack 是一个 100% 开源的大模型服务平台,用户只需要简单的设置,就可以高效整合包括 NVIDIA、Apple Metal、华为昇腾和摩尔线程在内的各种异构 GPU/NPU 资源,构建异构 GPU 集群,在私有环境提供企业级的大模型部署解决方案。

GPUStack 支持私有化部署 RAG 系统和 AI Agent 系统所需的各种关键模型,包括 LLM 大语言模型、VLM 多模态模型、Embedding 文本嵌入模型、Rerank 重排序模型、Text-to-Image 文生图模型,以及 Speech-to-Text(STT)和 Text-to-Speech(TTS)语音模型等。并提供统一认证和高可用负载均衡的 OpenAI 兼容 API,供用户从各类大模型云服务无缝迁移到本地部署的私有大模型服务。

继续阅读 →

你是否曾经感到技能提升遇到瓶颈?是否渴望成为一名独当一面的全栈大神?或者,你是否正在为找不到优质学习资源而苦恼?如果你对以上任何一个问题的回答是"是",那么恭喜你,你的机会来了!我们推出了一款全新的学习视频网站:fastclass.cn,专为 AI 全栈开发者量身定制,这里汇聚了最前沿的技术视频,从 Python 到 Curosr、React、Next.js、Figma、ChatGPT 等,应有尽有。我们会讲述如何使用这些技术来开发很多完整的项目,从零开始构建一个网站、开发一款移动应用,我们也会借助 Cursor 这样的 AI IDE 来开发项目,即使你没有编程经验也可以开发出自己的项目。

继续阅读 →在最近的 Chrome 更新版本中,看到一个非常令人兴奋的功能,那就是内置 AI,旨在将 AI 模型(包括大语言模型)直接集成到浏览器中。在用户浏览器端侧就可以直接启动 Gemini Nano 模型,借助内置 AI,您的网站或 Web 应用可以执行 AI 赋能的任务,而无需部署或管理 自己的 AI 模型。

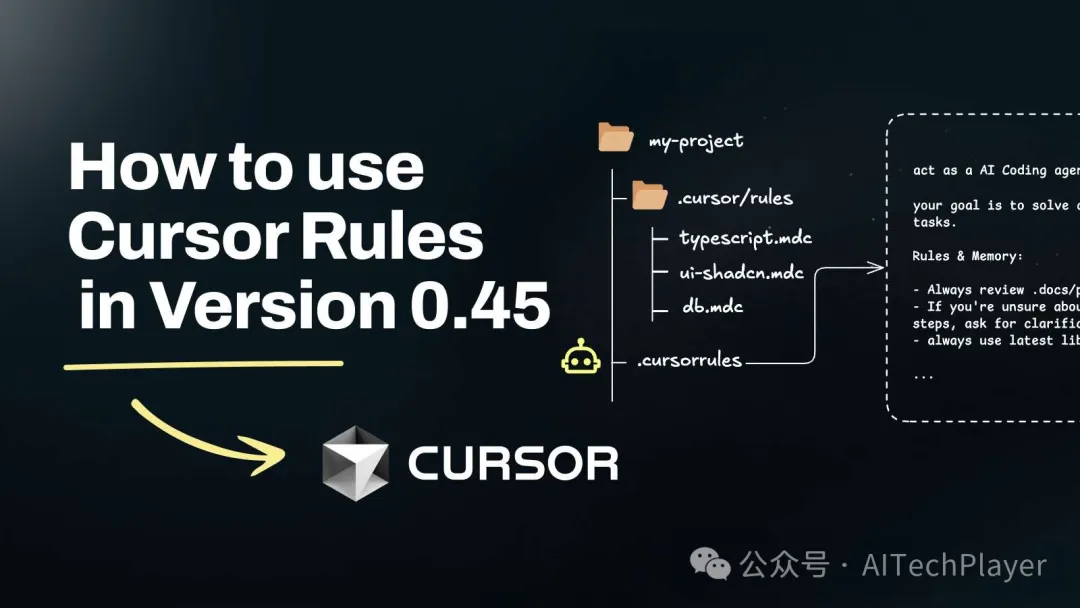

继续阅读 →Cursor AI IDE 是一个基于 AI 的 IDE,它可以帮助你编写代码,支持多种编程语言,包括但不限于 Go、Python、JavaScript、TypeScript、Rust 等。之前在 ChatGPT 爆火的时候,Cursor 也跟着火了一把,不过当时很多人是为了薅羊毛,白嫖 GPT-4 的体验,所以并没有多少人是真正使用它,而且之前的版本体验并不好,经常卡顿,官方在意识到这个问题后,重新基于 Visual Studio Code 重新开发了新的版本,体验直接上升了一个档次。而近期因为知名大 V(Andrej Karpathy) 的宣传,Cursor 再次引爆了整个 AI 圈,最近他连发了几条推特夸赞 Cursor 的智能程度,说 Cursor 的体验已经碾压了 GitHub Copilot。我也重新下载了最新的版本,体验了一下,确实比之前好用了很多,非常惊艳,说完爆 GitHub Copilot 不为过。

从今年开始,人们对大型语言模型 (LLM) 及其在 GPU 基础设施上的部署的兴趣显着增加。这种不断增长的热情是由人工智能和机器学习的进步推动的,这需要 GPU 能够有效提供大量的计算能力。GPU 领先制造商 Nvidia 的股价也因这一趋势而飙升。同样诞生了大量的大模型,对于这些模型的部署和管理也变得越来越重要,在这方面 Ollama 和 OpenUI 是一个不错的选择。

Ollama 是一个开源的机器学习模型部署工具,它可以帮助您将模型部署到生产环境中,简化大型语言模型 (LLM) 的管理和交互。Ollama 拥有各种一流的开源模型,例如 Llama 3、Phi 3、Mistral 等等,我们可以将 Ollama 看成是 Docker,但是专注于机器学习模型。